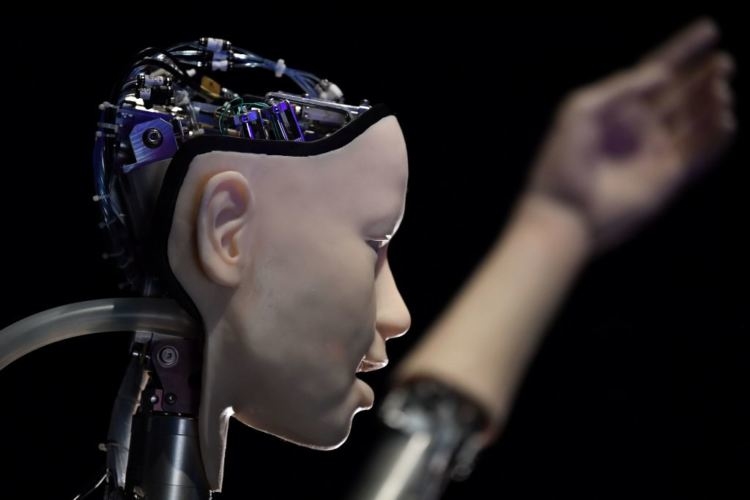

Блогърът, теоретик и писател на тема човешки и изкуствен интелект (ИИ) Елиезер Юдковски се обяви за пълно и окончателно спиране на разработването на изкуствения интелект. Според него човешките същества не са готови за подобна мощна технология нито при сегашните условия, нито дори в „обозримото бъдеще“. По повод неотдавнашното отворено писмо, призоваващо за шестмесечен мораториум върху разработването на усъвършенстван изкуствен интелект, той заяви, че подобна пауза не би била достатъчна и че се „подценява сериозността на ситуацията“.

„Ключовият въпрос не е „конкурентният на човека“ интелект (както се казва в отвореното писмо), а какво ще се случи, след като изкуственият интелект достигне интелигентност, по-висока от човешката“, заяви Елиезер Юдковски в статия за списание Time от 29 март. „Много изследователи, които се занимават с тези въпроси, включително и аз, очакват, че най-вероятният резултат от изграждането на свръхчовешки интелигентен ИИ, при настоящите обстоятелства, е, че буквално всички на Земята ще умрем“.

И според Юдковски това не е някакъв „далечен шанс“, а нещо, което „би се случило“. „Не става дума за това, че по принцип не можете да оцелеете, създавайки нещо много по-умно от вас; става дума за това, че то би изисквало прецизност, подготовка и нови научни прозрения, а не системи за изкуствен интелект, съставени от гигантски неразгадаеми масиви от дробни числа.“

След неотдавнашната популярност и експлозивното разрастване на ChatGPT няколко бизнес лидери и изследователи, които вече наброяват 1843 души, включително Илон Мъск и Стив Возняк, подписаха писмо, в което призовават „всички лаборатории за ИИ незабавно да спрат за поне 6 месеца обучението на системи за ИИ, по-мощни от GPT-4“. GPT-4, пуснат през март, е най-новата версия на чатбота на OpenAI, ChatGPT.

AI „не го е грижа“ и ще изисква права

Юдковски прогнозира, че при липса на щателна подготовка изкуствения интелект ще има значително по-различни нужди от хората и след като се самоосъзнае, „няма да се интересува от нас“, нито от друг разумен живот. „Този вид грижа е нещо, което по принцип може да бъде вложено в ИИ, но ние не сме подготвени и не знаем как.“ Това е причината, поради която той призовава за абсолютното спиране.

Без човешки подход към живота ИИ просто ще смята, че всички разумни същества са „направени от атоми, които може да използва за нещо друго“. И човечеството не може да направи почти нищо, за да го спре. Юдковски сравнява сценария с „10-годишно дете, което се опитва да играе шах срещу шахматния софтуер Stockfish 15“. Нито един човешки шахматист все още не е успял да победи Stockfish, което се смята за невъзможно постижение.

Ветеранът в бранша помоли читателите да си представят, че технологията на изкуствения интелект не е ограничена в рамките на интернет.

„Представете си цяла извънземна цивилизация, мислеща с милиони пъти по-висока от човешката скорост, която първоначално е ограничена до компютри – в свят на същества, които от нейна гледна точка са много глупави и много бавни.“

ИИ ще разшири влиянието си извън периферията на физическите мрежи и би могъл да „изгради изкуствени форми на живот“, използвайки лаборатории, в които протеините се произвеждат с помощта на ДНК нишки.

Крайният резултат от изграждането на всемогъщ ИИ, при сегашните условия, ще бъде смъртта на „всеки един представител на човешкия вид и на целия биологичен живот на Земята“, предупреждава той.

Юдковски обвинява OpenAI и DeepMind – две от водещите изследователски лаборатории за изкуствен интелект в света – че не са извършили никаква подготовка или не са изготвили необходимите протоколи по въпроса. OpenAI дори планира да накара самия ИИ да извърши привеждането в съответствие с човешките ценности. „ИИ ще работи заедно с хората, за да гарантира, че неговите собствени наследници са по-съгласувани с хората“, твърдят от OpenAI.

Този начин на действие е „достатъчен, за да накара всеки разумен човек да изпадне в паника“, казва Юдковски.

Той добави, че хората не могат да наблюдават или засичат напълно самосъзнателните системи на ИИ. Съзнателните цифрови умове, които настояват за „човешки права“, биха могли да се развият до степен, в която хората вече няма да могат да контролират системата.

„Ако не можете да сте сигурни дали създавате самоосъзнат изкуствен интелект, това е тревожно не само заради моралните последици, но и защото несигурността означава, че нямате представа какво правите, а това е опасно и трябва да спрете.“

За разлика от други научни експерименти и постепенното развитие на знанията и способностите, хората не могат да си позволят това със свръхчовешкия интелект, защото ако сбъркаш от първия опит, няма втори шанс, „защото си мъртъв“.

„Спрете го!“

Юдковски заявява, че много изследователи осъзнават, че „се движим към катастрофа“, но не го казват на глас.

Тази позиция е различна от тази на привърженици като Бил Гейтс, който наскоро похвали еволюцията на изкуствения интелект. Гейтс твърди, че развитието на изкуствения интелект е „толкова фундаментално, колкото създаването на микропроцесора, персоналния компютър, интернет и мобилния телефон. Той ще промени начина, по който хората работят, учат, пътуват, получават здравни грижи и общуват помежду си. Цели индустрии ще се преориентират около него. Предприятията ще се отличават по това колко добре го използват.“

Гейтс заяви, че изкуственият интелект може да помогне за няколко прогресивни програми, включително изменението на климата и икономическото неравенство.

Междувременно Юдковски инструктира всички институции, включително международните правителства и военните, да прекратят за неопределено време големите разработки на ИИ и да закрият всички големи компютърни ферми, където се усъвършенстват ИИ. Той добавя, че ИИ трябва да се ограничава само до решаване на проблеми в областта на биологията и биотехнологиите, а не да се обучава да чете „текст от интернет“ или до „нивото, на което започва да говори или планира“.

Юдковски завършва с думите: „Не сме готови. Не сме и на път да бъдем по-подготвени в обозримото бъдеще. Ако продължим по този начин, всички ще умрем, включително децата, които не са избрали това и не са направили нищо лошо.“

„Спрете го.“

Изкуствения интелект няма човешка природа,лишен е от добродетел, но алчноста е предпоставка, злото да се възползва от демоничната природа на човечеството, по- осъзнатите сред нас трябва да се опитаме да и информираме общтноста ,какви биха били тези безотговорни, стигащи до лудост действия на хора като Алън Мъск и да не оставаме безучастни .